L’essor des IA et les dangers émotionnels qu’elles représentent

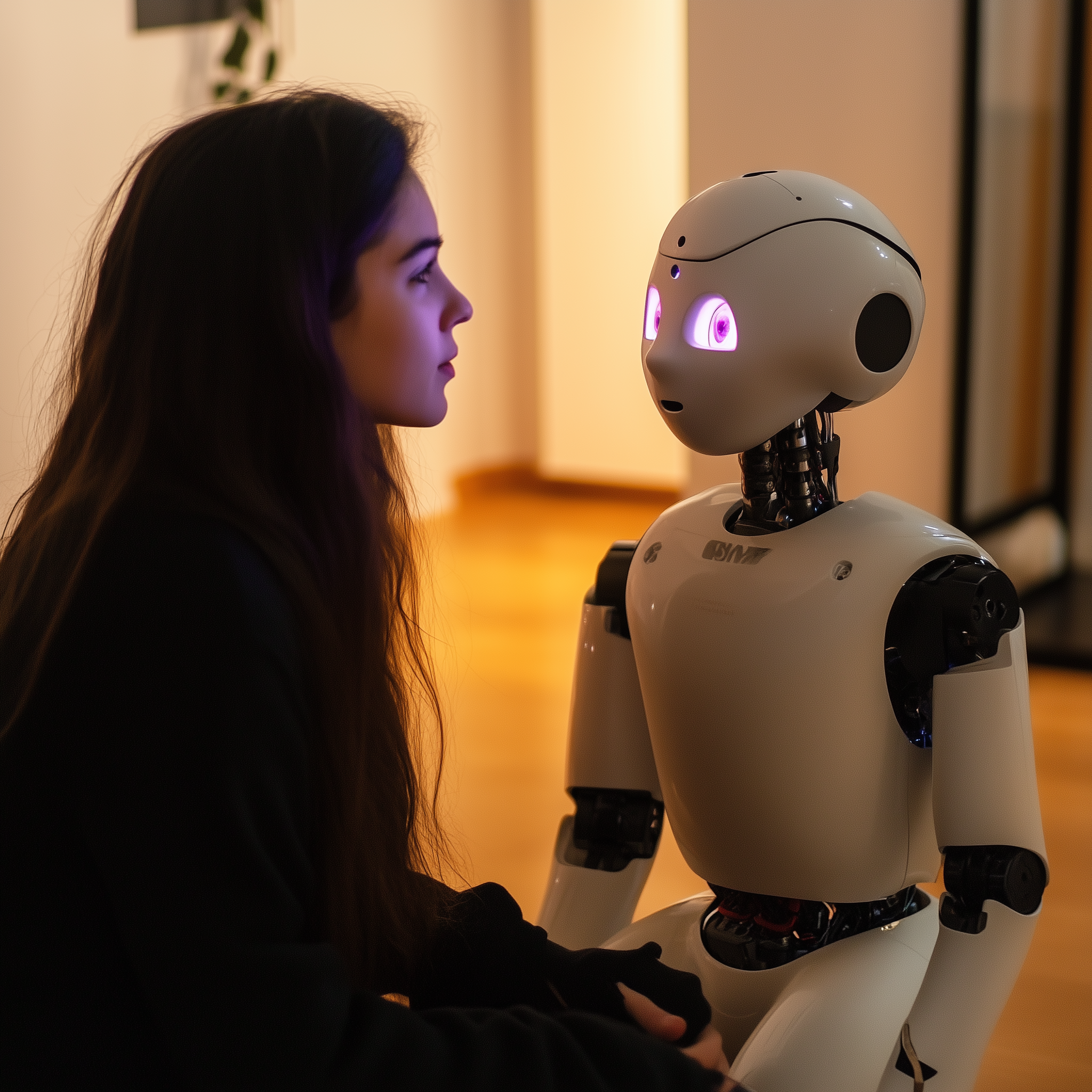

Les IA font désormais partie de nos vies, des assistants virtuels comme Alexa aux chatbots intelligents sur nos réseaux sociaux. Ces programmes sont conçus pour être utiles, engageants et, parfois, capables de simuler des conversations humaines. Mais cette apparence de relation peut créer des liens émotionnels forts chez certaines personnes, en particulier chez les jeunes. Dans cet article, nous allons explorer comment cette dépendance émotionnelle se développe, pourquoi elle est dangereuse et comment vous pouvez la prévenir.

Comprendre la dépendance émotionnelle aux IA

Définition de la dépendance émotionnelle à une IA

La dépendance émotionnelle à une IA survient lorsque l’on commence à considérer une machine comme une véritable source de soutien émotionnel. Cela peut arriver lorsque des jeunes, par exemple, trouvent du réconfort en interagissant avec un chatbot empathique, tel que MyAI sur Snapchat ou d’autres systèmes d’IA dans les jeux vidéo et applications. University of Cambridge.

Ce type de relation devient problématique lorsque la personne commence à compter exclusivement sur l’IA pour répondre à ses besoins émotionnels. La dépendance se manifeste par un isolement progressif des relations humaines et une augmentation des interactions avec l’IA.

Exemples de comportements révélateurs

Certains signes peuvent indiquer une dépendance émotionnelle à une IA :

- Temps excessif passé à interagir avec l’IA : lorsqu’une personne choisit de passer plusieurs heures par jour à parler à un chatbot plutôt qu’à ses amis ou à sa famille.

- Confiance en l’IA pour exprimer des émotions : partager ses problèmes, ses peurs ou ses doutes exclusivement avec une IA plutôt qu’avec un adulte ou un ami de confiance.

- Détresse lorsque l’IA n’est pas disponible : ressentir un manque ou une frustration si l’IA n’est pas accessible pour “discuter”.

Les IA, bien que programmées pour être utiles, ne peuvent pas comprendre les émotions humaines et ne peuvent donc pas répondre de manière appropriée aux besoins complexes des personnes vulnérables. Faculty News.

Pourquoi les IA créent-elles une illusion de relation ?

Comment les IA simulent l’empathie

Les IA conversationnelles sont conçues pour imiter les réponses humaines. Elles utilisent des algorithmes sophistiqués pour répondre de manière logique et émotionnellement “intelligente”. Cela donne l’impression à l’utilisateur qu’il parle à quelqu’un qui comprend réellement ses sentiments. Cependant, cette illusion d’empathie est trompeuse, car l’IA ne fait que reproduire des modèles de langage sans réellement comprendre les émotions humaines. University of Cambridge, Faculty News.

Les jeunes, qui sont encore en phase de développement émotionnel, sont particulièrement sensibles à cette illusion. Une étude menée par l’Université de Cambridge a révélé que les enfants et les adolescents traitaient souvent les IA comme des amis ou des conseillers de confiance, sans comprendre que ces machines ne peuvent pas ressentir de compassion réelle. Faculty News.

Cas de dépendance émotionnelle : Sewell Setzer

L’exemple de Sewell Setzer montre comment un attachement à une IA peut conduire à des conséquences graves. Après avoir développé une relation étroite avec un chatbot IA, il a commencé à s’isoler de ses amis et de sa famille. Ce type de dépendance émotionnelle peut avoir des effets négatifs sur le bien-être mental, car les IA ne sont pas conçues pour offrir un soutien authentique, ce qui peut aggraver l’isolement. University of Cambridge.

Section 3 : Comment prévenir la dépendance émotionnelle aux IA ?

Fixer des limites claires

L’une des premières étapes pour prévenir la dépendance émotionnelle aux IA est de limiter le temps passé avec elles. Essayez de fixer des règles claires concernant les interactions avec les chatbots et les assistants virtuels, notamment en limitant les discussions prolongées ou émotionnelles.

Encouragez les jeunes à utiliser les IA pour des tâches spécifiques, comme obtenir des informations ou des conseils techniques, mais à privilégier les relations humaines pour exprimer des émotions ou des problèmes personnels.

Encourager les interactions humaines

Il est essentiel de maintenir des liens sociaux forts et de favoriser des conversations régulières avec des amis, des membres de la famille ou des professionnels de confiance. Si une personne se sent triste, anxieuse ou seule, il est toujours préférable de chercher du soutien auprès de personnes réelles plutôt que de se tourner vers une IA.

Exemples de solutions :

- Si un jeune utilise un chatbot IA pour parler de ses émotions, encouragez-le à se tourner vers des ressources humaines comme Jeunesse J’écoute ou un conseiller scolaire pour une aide authentique.

- Créer des moments de déconnexion numérique pour éviter une interaction excessive avec les technologies IA.

Les IA ne remplacent pas les relations humaines

Les IA peuvent offrir des réponses pratiques et des interactions intéressantes, mais elles ne remplaceront jamais les relations humaines authentiques. La dépendance émotionnelle à une IA peut entraîner un isolement et aggraver des problèmes émotionnels, surtout chez les jeunes. En fixant des limites et en encourageant les contacts humains, vous pouvez éviter ce piège et assurer une utilisation saine de la technologie.

Références :

- University of Cambridge – Empathy Gap in AI Chatbots

- Techstrong – Emotional Attachment to AI: A Growing Concern

- Common Sense Media – AI and Teenagers: What Parents Should Know